Midjourney “/imagina…”. Pt. 1¿Qué son las IAs? (Ensayo: La Imaginación en el Ocaso)

En un dueto de artículos exploraremos un poco la relación de las IAs con la supuesta automatización de la imaginación. Pero primero necesitamos aclarar qué es esta tecnología

Este artículo pertenece a un ensayo sobre una (posible) crisis de imaginación (o de doxa) que se está acusando como diagnóstico, en los últimos años, a problemas políticos y sociales hacia la planificación. Comenzando, precisamente, con uno de los temas del momento, al que se le atribuyen grandísimos beneficios, o graves desastres, siempre a futuro. Si deseas leer la introducción a este ensayo por partes, para por ejemplo saber el objetivo que pretendo, o a qué me refiero con “crisis de imaginación” e incluso con palabras tan habituales, pero tan abstractas y ambiguas como “imaginación”, “imaginarios, puedes leerlo AQUÍ

Si te interesa también la Historia de la automatización, y las conexiones de imaginarios más simples con visiones del mundo, te puede interesar el anterior artículo “Un pato autómata y la visión del mundo”

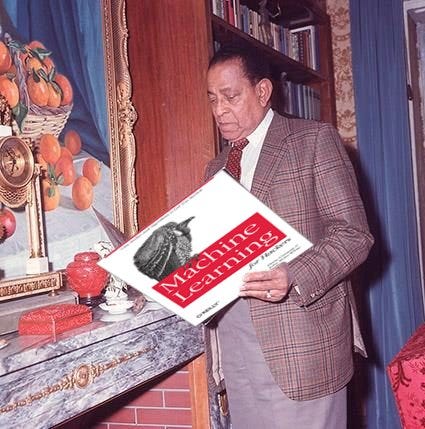

“What does it mean when computers are better at visual imagination than 99 percent of humans? That doesn’t mean we will stop imagining. Cars are faster than humans, but that doesn’t mean we stopped walking. When we’re moving huge amounts of stuff over huge distances, we need engines, whether that’s airplanes or boats or cars. And we see this technology as an engine for the imagination. So it’s a very positive and humanistic thing.” David Holz, fundador de Midjourney en una entrevista para The Verge, 22 agosto de 2022

Convertir la imaginación en una habilidad de las máquinas

Imagina que eres una becaria en una agencia de publicidad, y te has quedado sin ideas para un proyecto para un cliente. Llevas un par de semanas agotada, eso hace mella. Abres ChatGPT e introduces en su cajetín “Eres un creativo de BBDO. Un cliente te pide una campaña para… [introduce cuatro especificaciones de lo que te ha pedido]. Diséñame un plan en forma de bulletpoints, teniendo en cuenta las siguientes constricciones [le introduces un poco más de información de cosas que no debería hacer].”

Le das a intro mientras reprendes a sorbos un café amargo hecho en la Nespresso de la salita de descanso, y, en menos de 30 segundos, te ha creado un plan. Suena adecuado, al nivel de lo esperado. Un trabajo muy repetitivo, en parte, y aburrido, te lo ha hecho una máquina. Te vale lo que te ha hecho porque para lo que te pagan, como becaria, ya está bien.

Esta es un poco una de las promesas de las IAs generativas, y de la automatización desde tiempos de Vaucanson: “poder hacer el trabajo más engorroso” y “hacer más eficiente”. Todo esto en un contexto económico extendido desde hace unas décadas que está impactando también en sectores de servicios, orientado a la santa eficiencia.

Los resultados u outputs que arrojan estas máquinas parecen, sobre todo en las primeras experiencias, alucinantes. Lejos quedan aquellas imágenes psicodélicas repletas de ojos y tentáculos de “Deep Dream”, que se lanzó en 2015. Ahora la cosa ya parece seria, tal como venían prometiendo en el sector tecnológico digital.

Justo coincidiendo con el planteamiento de que hay una crisis de imaginación política y social en un contexto de Policrisis (incluyendo la Emergencia Climática), aparecen unas tecnologías que prometen ser igual o mejores que los humanos imaginando. No es que se esté usando el siguiente argumento como propuesta de valor de marketing, pero seguramente como pregunta se la han planteado algunos: ¿pueden las IAs ayudarnos a imaginar mejores sociedades?

De ahí pueden salir talleres, formaciones, exposiciones, conferencias, etcétera, pero yo creo que hay otras preguntas más interesantes: ¿qué están diciendo realmente quiénes venden IA que pueden imaginar las máquinas? ¿De qué hablan cuando hablan de imaginación?

¿En qué consisten las IA? Tratando de reproducir el cerebro humano

La Inteligencia Artificial no es una tecnología, sino un paraguas de diferentes tecnologías, sistemas y técnicas. Más aun, es en realidad una disciplina, iniciada en torno a los años 1950, justo en paralelo y de la mano con la emergencia de la computación moderna, lo que nos trae a los dispositivos que estamos usando aquí y ahora para leernos.

Su propósito original era modelar los procesos de cognición humana. En teoría, más como una forma abductiva y experimental de estudiar cómo podría funcionar nuestro cerebro y sistema nervioso, y dar lugar a mejores explicaciones científicas, a través de simulaciones. Pero en algún momento de esta historia, el desarrollo de estas tecnologías tuvo un atractivo económico.

Entretanto, también se gestó la hipótesis, luego la expectativa, luego el mito, de poder gestar una Inteligencia Artificial que imitase muy bien todas las capacidades cognitivas de un humano. Entendida en ocasiones, incluso, como una promesa a la que estamos destinados de acometer como fruto de nuestra carrera tecnológica .

“The stated goal of many organizations in the field of artificial intelligence (AI) is to develop artificial general intelligence (AGI), an imagined system with more intelligence than anything we have ever seen. Without seriously questioning whether such a system can and should be built, researchers are working to create “safe AGI” that is “beneficial for all of humanity.” Timnit Gebru, Emile P. Torres (2024). The TESCREAL bundle: Eugenics and the promise of utopia through Artificial Intelligence https://firstmonday.org/ojs/index.php/fm/article/view/13636

A la idea de conseguir una Inteligencia Artificial “real”, completa a imagen e inspiración de la inteligencia humana o superior, se le suele llamar “Inteligencia Artificial General” (o AGI por sus siglas en inglés). Y de ahí, la especulación de que, si se consiguiera, entonces podría ser posible el desarrollo o “aparición” de una Super Inteligencia Artificial (o ASI en inglés).

Es decir, que entonces se conseguiría que las máquinas superasen en inteligencia a la inteligencia humana. Por tanto, la idea más cercana a casi un dios. (Si no leíste el artículo anterior, lo recomiendo porque aquí entra en juego una Scala Dei fosilizada con un Dios relojero)

Pero esas cosas todavía no se han conseguido, porque, tal como explica la investigadora Margaret Boden (2018) entre varios entendidos más (como Jeff Hawkins), si algo ha servido el campo de IA de la mano de las Ciencias Cognitivas, es a descubrir que los procesos cognitivos (incluyendo la imaginación, pero también cosas más “simples” como movernos, caminar…) son más complicados de lo que aparentaban cuando comenzaron a teorizar la IA y el funcionamiento cognitivo humano, en torno a los años 1950 y 1960. Hay muchos procesos no solo eléctricos sino químicos, mecánicos, y también debidos a propiedades que emergen en sistemas complejos, que todavía se están tratando de desentrañar.

En algún punto de esta Historia, a los programas y sistemas de IA comenzaron a vérseles aplicaciones comerciales interesantes, y el mundillo de investigación se convirtió también en un hervidero tenso por ver quién podía asegurar más financiación para sus proyectos.

Digamos que, aunque existen varios grandes caminos o tipos de IA, han destacado dos tipos: las IAs simbólicas (cuando se habla de símbolos es más un tema de programación que no de semántica profunda), y las Redes Neuronales Artificiales.

Las redes neuronales en su origen trataban de imitar un modelo de cómo se creía que funcionaba la transmisión de información entre neuronas simple (el modelo de Russell y Sherrington), pero en el transcurso del desarrollo más comercial en las últimas décadas, el campo se despegó un tanto de la aspiración a estudiar o modelar e imitar el cerebro humano (insisto, al menos en lo que son las aplicaciones más comerciales o industriales). Por lo que la similitud entre los tejidos neuronales y las redes neuronales artificiales tiende a ser más vaga, pero sí muy aspiracional en discurso.

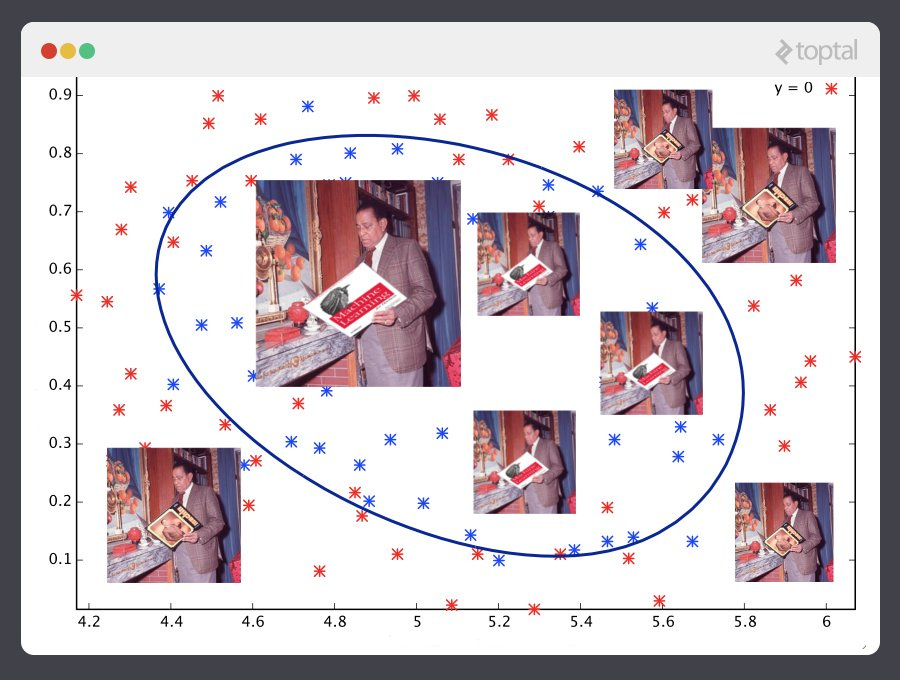

El Machine Learning (o Aprendizaje Automatizado), el Deep Learning (Aprendizaje Profundo) y las IAs generativas se basan todas, en general, en redes neuronales artificiales. Y en general, las redes neuronales, se basan un poco en sistemas lógicos, pero sobre todo en grandes cantidades de datos (Big Data) y probabilística masiva. Algo así como una estadística refinadísima que permite hacer cosas flipantes.

En concreto, las IAs generativas actuales que conocemos, como ChatGPT o Midjourney (que, además, se basan en técnicas diferentes como GANs, Transformers…), se fundamentan en el Aprendizaje Profundo combinado con otras técnicas, y que hacen que la IA no solo analice, sino cree “datos nuevos” en formato de contenido, tal como textos, conversaciones, vídeos o imágenes.

Dejaré aquí un par de recursos para ampliar el entendimiento de estas tecnologías, que creo que es muy importante darle difusión.

Maria Campins (2022) ¿Qué es el Machine Learning? https://www.newtral.es/machine-learning-que-es/20221209/

Visual Storytelling Teams y Madhumita Murgia (2023). Generative AI exists because olf the transformer (es muy visual, algo interactivo, de lo más pedagógico visto hasta ahora) https://ig.ft.com/generative-ai/

Actualmente, las partes interesadas en acelerar sus negocios nos venden cada equis tiempo que existe un peligro existencial basado en que la AGI está cerca, y por tanto la ASI, y que pondrá en riesgo a “la Humanidad”. También nos dicen que realmente imitan capacidades humanas, cuando no ocurre probablemente. Aunque sean máquinas que hacen cosas, técnicamente, muy sofisticadas (lo cortés no quita lo valiente).

La distancia entre el conocimiento operativo que se tiene dentro de esos campos versus el conocimiento que tenemos la mayoría de los mortales, es cada vez mayor, y, como decía Arthur C. Clarke como advertencia “Cualquier tecnología lo suficientemente avanzada es indistinguible de la magia”.

Este capítulo del podcast “Saldremos mejores” donde invitaron a Carmen Torrijos, experta en IA y lenguaje, que explicó amorosamente qué son y qué hacen (si buscas directamente su entrevista, comienza hacia la mitad del programa)

(está también en otras plataformas habituales de podcast, por si prefieres escucharlo)

Qué hacen las IAs generativas comerciales

En uno de los artículos que he compartido, explican muy bien cómo funcionan los Large Language Models (LLM) o Modelos de Lenguaje Extensos con más detalle. Igual que ocurre con el concepto “IA”, la IA Generativa, de nuevo, no es una sola tecnología, sino que son varias técnicas, en función del tipo de “contenido” o formato que se espera generar.

Así, para poder desarrollar imágenes, se usará algo distinto a los LLM, mucho más largo de explicar porque se pueden combinar varios sistemas. O para desarrollar música y sonido, se usará también otras técnicas computacionales.

Eso sí, los LLM son esenciales no solo para generar texto a secas, sino para poder crear interfaces humano-máquina con otros tipos de generativas (como las de imagen); para poder ordenarle la producción de obras, mediante “prompts” y que lo traduzca en comandos inteligibles para los otros sistemas que manipularán bits, píxeles y algoritmos. Por ello y más razones, los LLM son una tecnología esencial en todas las IAs generativas.

Como decía, la base de las generativas son el Deep Learning, que es un subtipo de Machine Learning con menos supervisión en el entrenamiento (se automodulan y detectan y moldean parámetros propios, “aprenden”), todo basado en una lógica totalmente probabilística y casi también aleatoria, llamado estocástica.

Primero aprenden (pero no como aprendemos los humanos) la relación entre palabras, o entre píxeles de colores, u otros tipos de datos; su proporción y probabilidad de aparecer juntas, y luego -resumiendo muchísimo- tratan de generar algo nuevo basado en unas peticiones o prompts, y esos “aprendizajes” previos que han generado modelos sintéticos enormes.

Aunque no quiero extenderme más en este punto porque hay mucho por debatir, hay que añadir que estas tecnologías, todavía hoy en día, tienen un coste muy, muy alto. Y no hablo de las suscripciones o el precio que imponen a los usuarios en sí.

Para poder computar estos grandes modelos de imágenes, de lenguaje, de vídeo, de lo que sea, se necesitan:

Supercomputadoras, que consisten en un montón de “servidores” de nueva generación con procesadores especializados, todos entreconectados para conformar una unidad de “supercomputación”. O sea, estamos hablando de espacios estilo grandes centros de datos que asociamos con “la Nube”. En ocasiones pueden cumplir ambas funciones: computar y almacenar

Por tanto, necesitan recursos especiales para computar. En el caso de la mayoría de IAs generativas, se utilizan GPUs (tarjetas gráficas). Pero no cualquier tarjeta gráfica, como las de nuestros ordenadores, sino unas especiales. Actualmente hay muy pocos modelos apropiados, siendo las de NVidia las más vendidas

Consumen mucha energía. Para la computación, para la climatización y para refrigerar. Pueden consumir en la fase de entrenamiento tanto como un barrio residencial durante un año, aunque, luego, cuando ya se usan de manera más habitual por cientos de miles de usuarios, consumen algo menos

Consumen agua. Mucha agua. Dicha agua se utiliza exclusivamente para refrigerar -además de usar unos super-ventiladores. Del mismo modo que notamos nuestros dispositivos sobrecalentarse cuando están procesando un programa o un vídeo con mucho peso, o un juego, algo así pero todavía más caliente ocurre. Así que necesitan un sistema constante de refrigeración eficiente

Digresión: la “Artificial Inteligencia Artificial”; otra de autómatas que parecían inteligentes, pero eran humanos precarizados haciendo inteligente a la máquina

Un busto tallado en madera, elegantemente pintado, con un turbante en su cabeza delante de un tablero de ajedrez sobre un gabinete, juega contra un hombre de carne y hueso con la misma destreza que un humano. El año es 1780 y esta historia fue real.

A este maravilloso autómata, que ganó muchas partidas durante más de 80 años, y estuvo en las Cortes y salas sociales más refinadas del norte de la época, se lo conocía como el turco mecánico o el ajedrecista autómata.

Se dice que ganó al mismísimo Napoleón Bonaparte. Se consideró durante finales del siglo XVIII y principios del XIX como una gran proeza de la mecánica. De la mecanización de la capacidad de raciocinio, de pensar.

Este ingenio es mucho más famoso que el pato de Vaucanson. Seguramente ya habrás oído alguna vez sobre éste, aunque sea en forma de metáfora: el turco mecánico. Hasta Amazon tiene una plataforma de trabajos por microtareas para humanos llamado “Mechanical Turk”, desde hace más de una década.

En Amazon Mechanical Turk, algunas tareas pueden estar destinadas a etiquetar y gestionar datos, como podrían ser imágenes, para crear bases de datos de entrenamiento para IAs contemporáneas. O bien tareas para el sector público o para agencias de investigación, para buscar en imágenes públicas a personas desaparecidas. O escribir o revisar pedazos de código. Tareas relativamente simples que no requieren conocimientos técnicos avanzados.

Jeff Bezos, el fundador de Amazon, a esta lógica de crowdsourcing, le llamó “Inteligencia Artificial Artificial” (sic, no es un error la repetición) en torno al año 2000. Esto es, parece Inteligencia Artificial, pero es falseada; hay una legión de personas desarrollando cachitos de trabajos detrás por unos pocos dólares por tarea.

Hasta casi un siglo después de la invención del turco mecánico, se descubrió la mentira: allí debajo del tablero de ajedrez, donde parecía que se escondían los misteriosos mecanismos que hacían funcionar y “pensar” creativamente al autómata ajedrecista, se escondía un jugador profesional algo bajito y, mediante un segundo tablero con mecanismos e imanes más simples, podía interactuar con el otro jugador, el engañado.

Es algo similar a lo que ocurrió con el pato digeridor, en torno al cual se creó la ilusión de ser un artefacto con unas capacidades que no tenía. Que podía hacer todo el proceso de digestión de un ser vivo. De hacer lo que su inventor decía que había conseguido reproducir. Pero un siglo después, también, se pudo ver sus entrañas y descubrir que no digería ni procesaba nada, sino que tenía dos compartimientos. Uno para guardar el grano, y otro para expulsar un líquido similar a caca de pato. Y que también engañó hasta a gente tan inteligente como el matemático de La Mettrie o al filósofo Voltaire.

Hay quien diría que podemos considerar un artefacto como vivo o inteligente si a nuestro criterio da resultados de estar vivo o ser inteligente. Pero el problema no está solo en el resultado, porque puede ser todo resultado de salas chinas o ilusionismo.

De manera más práctica, nos venden una tecnología que está desarrollada en un nivel que no lo está. Y eso tiene consecuencias, como el planteamiento de los casos prácticos, como por ejemplo cuando se nos dice que se puede utilizar para buscar información, pero solo genera textos que parecen títulos verosímiles de artículos

Detrás de las IAs generativas, como se ha comentado, han trabajado, además de equipos de ingenieros bien pagados, también legiones de trabajadores precarizados, en países donde el salario es mucho más bajo (como Kenya o Nigeria ).

Estos trabajadores estaban al cargo de etiquetar las bases de datos de entrenamiento, o en moderar modelos de lenguaje ya operativos para hacerlos menos racistas, machistas… Un proceso que no lo pudo aprender la propia IA, sino que necesitaron añadir a personas para introducir valores y contexto, y “procesar” y conducir la lectura de la información.

Todo esto también da lugar a reflexiones complicadas sobre cómo se extrajeron las imágenes y obras de internet para crear las bases de datos de entrenamiento de las IAs, en ocasiones bases que están en modo Open Source.

Reflexiones complicadas porque los problemas derivan de cómo funcionan las IAs generativas. No remezclan exactamente partes de obras originales, sino que descomponen todas las imágenes en modelos numéricos, y a partir de ahí generan nuevas obras (resumiendo mucho).

El problema es que en el proceso de recolección no se han pedido permisos o se ha abusado de licencias Creative Commons (sin generar nada en tal licencia, o equivalentes de Open Libre Source, salvo algunas excepciones como Diffusion), y hay grandes empresas que se están lucrando del esfuerzo de otros.

Es en realidad una vieja historia donde tiene más importancia las estructuras económicas, financieras y legales, que no una IA que, aunque sofisticada, no es realmente equivalente a un ser humano en lo cognitivo. Y que, por ejemplo, las luchas de hace un año de actores y guionistas, tuvieron cosas muy importantes a añadir. Pero esto quizás sea otro tema, que trataré más adelante porque es importante para entender la salud de la creatividad colectiva.

En el próximo artículo reflexionaremos sobre justamente la automatización de la creatividad y la imaginación desde el paradigma de las IAs, ahora que (espero) he extendido una forma de entender estas tecnologías fascinantes y problemáticas por igual.